AI-оптимизация рецептур и составов химических продуктов

Разработка рецептуры вручную — итерационный процесс: химик изменяет соотношение компонентов, ждёт синтеза и тестирования (дни-недели), интерпретирует результат, делает следующую итерацию. AI сокращает это до нескольких направленных экспериментов.

Где это применяется

Специальная химия, лакокрасочные материалы, клеи и герметики, моющие средства, косметика, полимерные компаунды, смазочные материалы, фармацевтические формуляции, агрохимия. Задача везде одна: найти оптимальный состав из N компонентов при ограничениях на стоимость, экологию, доступность ингредиентов и требованиях к свойствам конечного продукта.

Глубоко: Bayesian Optimization для направленного поиска

Это ключевая техника для оптимизации рецептур, когда каждый эксперимент дорог.

Почему не перебор и не DOE. Full factorial design на 10 компонентах с 5 уровнями — 5^10 ≈ 10 млн экспериментов. Fractional factorial DOE уменьшает это до нескольких сотен, но не учитывает результаты предыдущих экспериментов адаптивно.

Bayesian Optimization строит surrogate модель (чаще всего Gaussian Process) поверхности отклика и использует acquisition function для выбора следующей точки эксперимента. BoTorch (PyTorch) — производственная реализация с поддержкой:

- Multi-objective BO: несколько целевых свойств одновременно (например, адгезия + вязкость + стоимость); qNEHVI acquisition function строит Pareto-фронт

- Constrained BO: нельзя превышать концентрацию компонента X, стоимость рецептуры не более Y

- Batch BO: предлагать K экспериментов одновременно для параллельного синтеза в лаборатории

На реальном кейсе (рецептура эпоксидного адгезива, 8 компонентов, цели: прочность на сдвиг > 20 МПа, удлинение при разрыве > 5%, стоимость < N руб/кг): Bayesian Optimization нашёл Pareto-оптимальные составы за 43 итерации против ~150 в исторических экспериментах по традиционному DOE. Экономия времени разработки — ~8 недель.

Gaussian Process vs. Neural Network surrogate. GP работает хорошо на малых выборках (< 200 точек) и даёт calibrated uncertainty estimates — важно для acquisition function. При >500 точках экспериментальных данных переходим на Deep Ensembles или BNN (Bayesian Neural Network) через Pyro/NumPyro — они лучше масштабируются.

Предсказание свойств по составу: ML-модели

Параллельно с оптимизацией строим предсказательные модели свойств:

Для составов без молекулярной структуры (рецептуры смесей):

- Входные фичи: концентрации компонентов, их физико-химические свойства (растворимость, плотность, молярная масса)

- Модели: Gaussian Process, XGBoost/LightGBM, Neural Network с uncertainty quantification

- Метрики: RMSE, R² на holdout; важна оценка uncertainty для extrapolation detection

Для молекулярных структур (новые индивидуальные вещества):

- GNN на молекулярном графе (chemprop, D-MPNN)

- Фичи: конституционные, топологические, геометрические дескрипторы (RDKit → 200+ признаков)

Смешанный подход: рецептура из известных компонентов + новые молекулы — комбинация табличного ML и GNN через ансамблирование или feature concatenation.

Работа с малыми данными

Типичная проблема: 30–80 исторических экспериментов. При этом работает:

- Transfer learning: предобученный GNN на широком датасете (ChEMBL, NIST) + fine-tune на малой внутренней выборке

- Active learning: модель сама выбирает, какие эксперименты провести для максимального снижения uncertainty (query by committee или BALD criterion)

- Data augmentation для составов: физически обоснованные интерполяции (линейные смеси компонентов дают предсказуемое поведение для многих свойств)

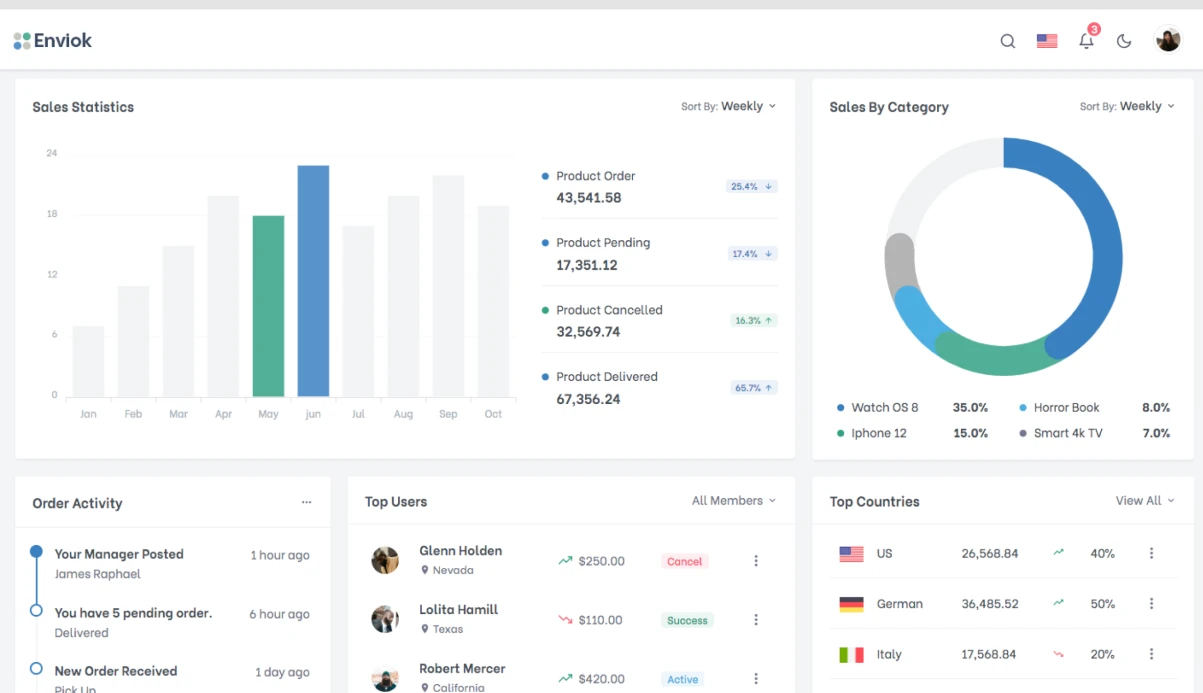

Интерфейс для химика-разработчика

ML-инструмент для разработчика рецептур — не чёрный ящик. Обязательные элементы:

- SHAP для объяснения предсказаний: "компонент А вносит +15% в прочность, компонент B — −8%"

- Uncertainty display: точки экстраполяции явно помечены, модель говорит "не знаю" в незнакомых областях

- Constraint builder: визуальный интерфейс для задания ограничений на состав

- Experiment suggester: следующие N рекомендуемых экспериментов с ожидаемым приростом целевого свойства

Процесс

- Сбор исторических данных — лабораторные записи, LIMS-выгрузки, нормализация единиц

- Feature engineering — кодирование компонентов, добавление физико-химических дескрипторов

- Baseline surrogate model — GP или LightGBM на исторических данных

- Active learning loop — предложение экспериментов → синтез → обновление модели

- Multi-objective optimization — Pareto-фронт для финального выбора рецептуры

- Документация — SHAP-объяснения для R&D отчёта

MVP (один целевой продукт, имеющийся датасет): 6–10 недель. Платформа многопродуктовой оптимизации с active learning interface для лаборатории: 4–8 месяцев.